Uno de los conjuntos de datos más utilizados para la investigación en mantenimiento predictivo aeronáutico es el Commercial Modular Aero-Propulsion System Simulation (CMAPSS) de la NASA. Este conjunto de datos simula el comportamiento de motores turbofán y proporciona mediciones de múltiples sensores a lo largo del tiempo, permitiendo estudiar procesos de degradación y detección de anomalías en condiciones realistas.

Cuando se trabaja con modelos complejos de inteligencia artificial para la detección de anomalías, una de las principales preguntas no es solo si existe una anomalía, sino por qué el modelo ha llegado a esa conclusión. En este contexto, las técnicas de Explainable Artificial Intelligence (XAI) permiten abrir la caja negra de modelos como las redes LSTM y ofrecer explicaciones comprensibles para usuarios humanos.

Entre las técnicas más utilizadas destacan SHAP, LIME e Integrated Gradients, cada una con un enfoque diferente para explicar las predicciones del modelo.

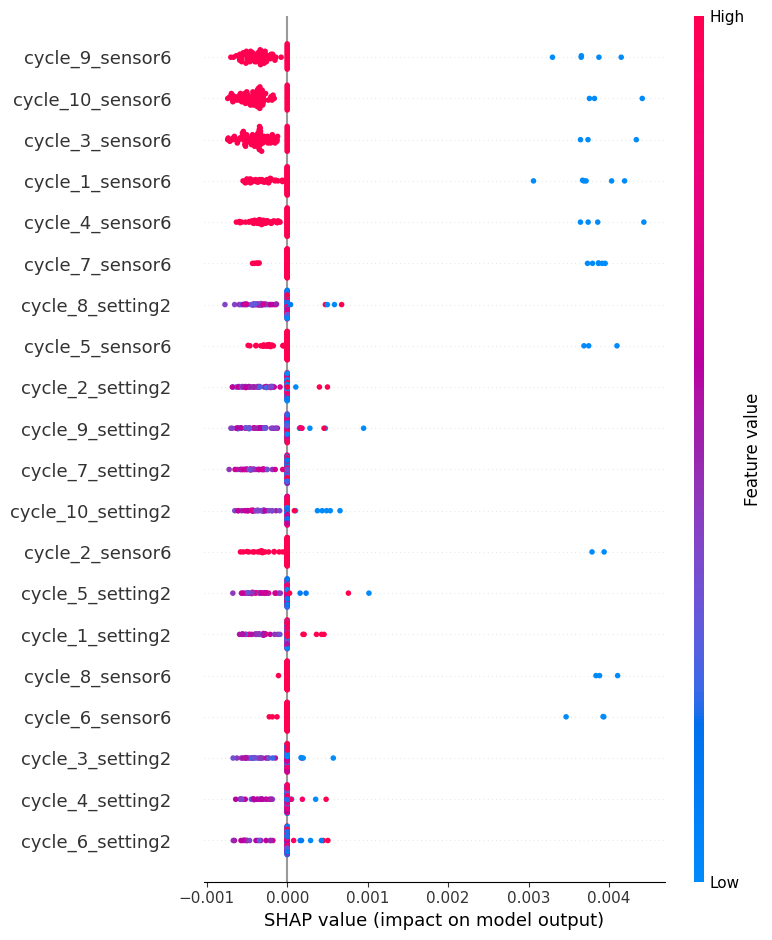

SHAP (SHapley Additive exPlanations) se basa en conceptos de la teoría de juegos y asigna a cada característica una contribución a la predicción final. En el caso de la detección de anomalías con datos del conjunto CMAPSS, SHAP permite identificar qué sensores tienen mayor influencia en la decisión del modelo. Una de sus principales ventajas es que ofrece tanto explicaciones locales (para instancias concretas) como una visión global del comportamiento del modelo. Esto resulta especialmente útil para detectar patrones recurrentes asociados a la degradación de los motores.

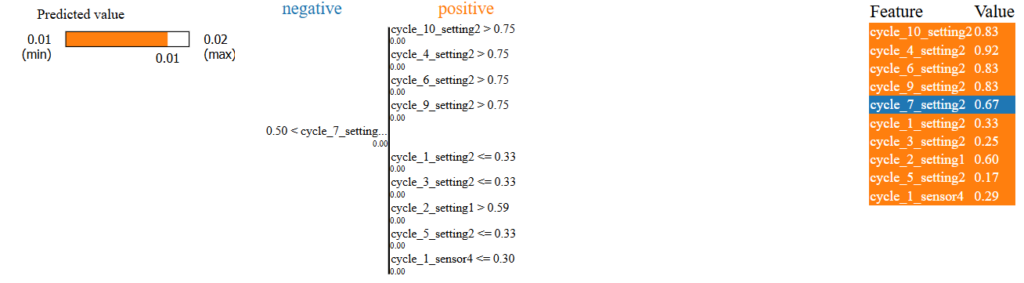

LIME (Local Interpretable Model-agnostic Explanations), en cambio, se centra exclusivamente en explicaciones locales. Su objetivo es aproximar el comportamiento del modelo complejo en el entorno cercano a una predicción concreta mediante un modelo interpretable. Aplicado a la detección de anomalías, LIME ayuda a entender por qué una secuencia específica ha sido clasificada como anómala, destacando las variables más relevantes en ese instante. Esta técnica es especialmente valiosa para el análisis puntual de eventos críticos.

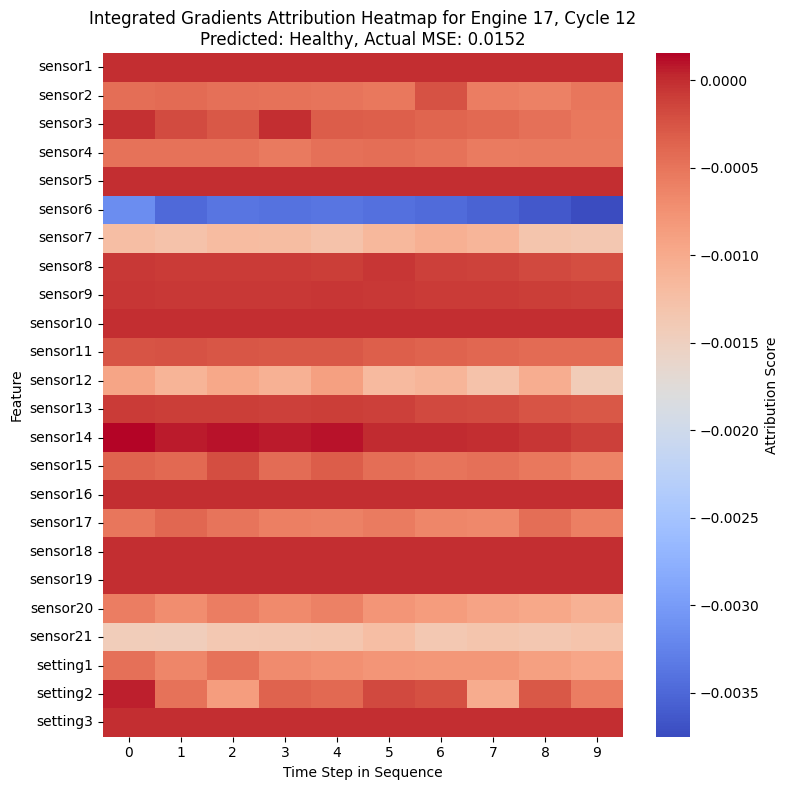

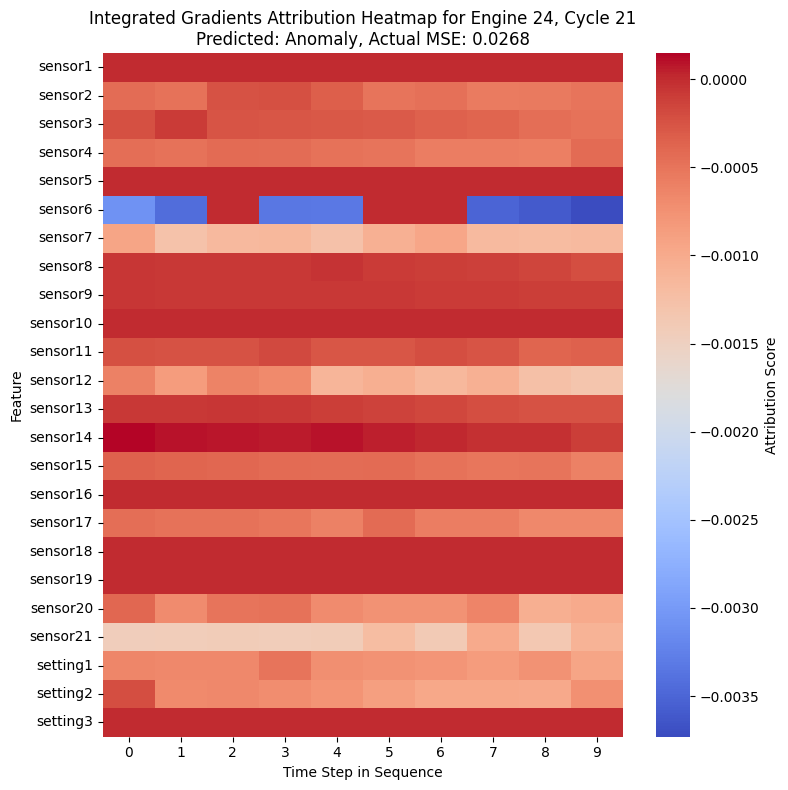

Integrated Gradients aprovecha la información de los gradientes del modelo para medir la contribución de cada característica a la predicción. A diferencia de SHAP y LIME, esta técnica está estrechamente ligada a la arquitectura del modelo, lo que la hace especialmente adecuada para redes neuronales profundas. En modelos LSTM, Integrated Gradients permite analizar cómo la importancia de los sensores evoluciona a lo largo del tiempo, proporcionando una interpretación más alineada con la naturaleza secuencial de los datos.

Aunque estas tres técnicas persiguen el mismo objetivo de explicar las decisiones del modelo, sus resultados no son idénticos ni intercambiables. SHAP ofrece una visión más global y consistente, LIME resulta útil para análisis locales rápidos, e Integrated Gradients aporta una perspectiva temporal especialmente relevante en series temporales.

En entornos críticos como la aeronáutica, combinar varias técnicas de XAI puede ser la mejor estrategia. El uso conjunto de SHAP, LIME e Integrated Gradients no solo mejora la confianza en los modelos de detección de anomalías, sino que también proporciona explicaciones más completas y robustas, facilitando la validación de los sistemas y el apoyo a la toma de decisiones técnicas.