La Explicabilidad en Inteligencia Artificial (XAI) no solo se basa en librerías específicas como las revisadas en entradas anteriores, sino también en herramientas interactivas que permiten analizar modelos de Machine Learning (ML) de manera intuitiva y visual. En esta entrada, exploraremos dos herramientas diseñadas para facilitar la interpretabilidad de modelos de ML: What-if Tool y xCOLIBRI-IoT.

What-if Tool

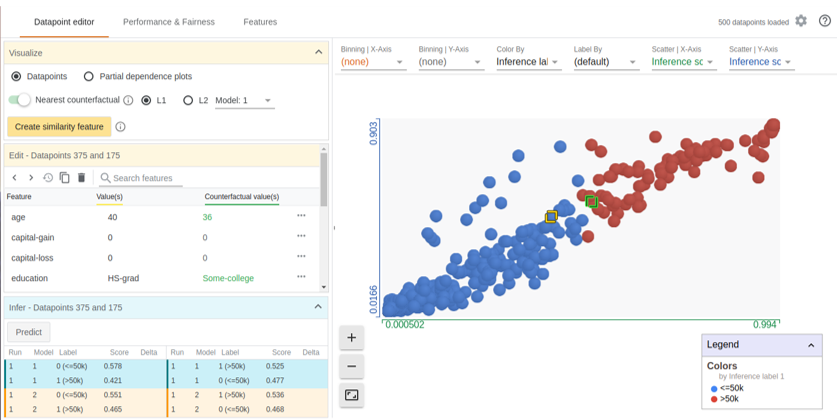

What-if Tool fue desarrollada por la People+AI Research Initiative como una herramienta interactiva integrada en TensorBoard, Jupyter Notebook y Google Collaboratory. Su propósito es facilitar el análisis de modelos de ML sin necesidad de escribir código, a través de una interfaz visual e interactiva.

Las principales funcionalidades de What-if Tool incluyen:

- Exploraciones «What-If»: Permite modificar las entradas del modelo y observar en tiempo real cómo cambian las predicciones.

- Análisis Contrafactual: Identifica ejemplos similares con predicciones distintas para comprender mejor el comportamiento del modelo.

- Análisis de Sesgos: Permite medir la paridad demográfica y analizar el desempeño del modelo en diferentes subgrupos, ayudando a identificar sesgos.

- Comparación de Modelos: Facilita la evaluación de múltiples modelos sobre un mismo conjunto de datos.

- Soporte para Múltiples Técnicas de Interpretabilidad: Incluye gráficos de dependencia parcial (PDP), análisis contrafactual y exploraciones What-If.

Esta herramienta es compatible con cualquier modelo de predicción y representa una solución accesible para la exploración de modelos de ML sin necesidad de experiencia en programación avanzada.

xCOLIBRI-IoT

El grupo GAIA de la Universidad Complutense de Madrid (UCM) ha desarrollado xCOLIBRI-IoT, una herramienta avanzada enfocada en la explicabilidad de modelos de IA aplicados al Internet de las Cosas (IoT). Basada en el marco de Razonamiento Basado en Casos (CBR), xCOLIBRI-IoT ayuda a mejorar la transparencia de los sistemas de IA en entornos críticos.

Entre sus características principales destacan:

- Adaptabilidad a Sistemas IoT: Permite personalizar los métodos de explicación según las necesidades específicas de cada aplicación IoT.

- Selección Óptima de Métodos XAI: Utiliza una base de casos que analiza diferentes técnicas de explicabilidad, eligiendo la más adecuada para cada situación.

- Integración con Herramientas XAI Populares: Compatible con LIME, valores de Shapley, integrated gradients y otros enfoques avanzados de explicabilidad.

- Ontología XAIoT-Onto: Proporciona un marco estructurado para gestionar los requisitos de explicabilidad en sistemas IoT.

Gracias a su enfoque estructurado y flexible, xCOLIBRI-IoT facilita la implementación de soluciones explicables en entornos IoT, permitiendo a los usuarios comprender mejor la toma de decisiones de los modelos de IA.