Cuando reconstruyes una escena con Gaussian Splatting y reproduces dentro de ella una trayectoria de cámara equivalente a la real, la pregunta obvia es: ¿cuánto se parece lo que ves en el simulador a lo que capturaste en el mundo real?

Para responder eso, comparamos dos vídeos: uno grabado con un móvil recorriendo una escena con objetos sobre una mesa, y otro generado en Unity reproduciendo esa misma trayectoria sobre la escena reconstruida. Los dos vídeos tenían resoluciones y framerates distintos, así que la sincronización no pudo ser fotograma a fotograma. En su lugar, usamos el progreso relativo dentro del clip: si estás al 30% del vídeo real, coges el fotograma que está al 30% del simulado. Así obtuvimos 48 pares de fotogramas comparables.

Las métricas

Usamos tres métricas principales.

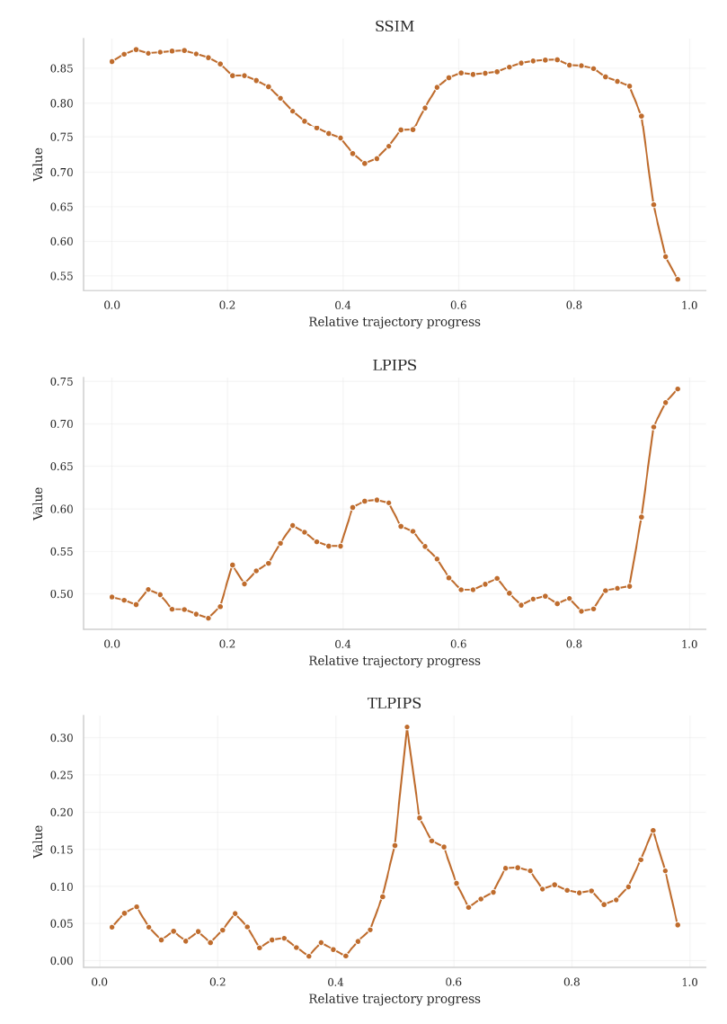

SSIM mide si la estructura espacial de las imágenes se parece. El valor medio fue 0.808. Eso indica que la organización global de la escena se mantiene: los objetos aparecen en posiciones parecidas y la distribución de luces y sombras no es radicalmente distinta.

LPIPS mide diferencia perceptual usando redes neuronales. Aquí el valor fue 0.537, que ya no es tan cómodo. Significa que si miras los fotogramas hay diferencias visibles. El simulador no replica la apariencia exacta de los materiales, los reflejos ni algunos detalles finos.

tLPIPS mide algo distinto: no compara fotogramas entre sí, sino cómo cambia la apariencia de un fotograma al siguiente. El valor fue 0.080, bastante bajo. Eso dice que la forma en que evoluciona la imagen a lo largo del recorrido es similar en los dos vídeos, aunque los fotogramas individuales no sean idénticos.

El problema de la uniformidad

La parte más interesante no está en los promedios sino en cómo varían esas métricas a lo largo de la trayectoria. No hay un nivel constante de similitud. Hay segmentos donde los dos vídeos se parecen bastante, y otros donde la diferencia es clara. El peor momento de alineación ocurre alrededor del 44% del recorrido, y eso se ve tanto en las métricas como a simple vista en las imágenes.

Esto importa porque si solo miras el promedio puedes llevarte una impresión equivocada. La reconstrucción no falla de forma uniforme. Hay partes de la trayectoria que resultan más complicadas, probablemente por ángulos de cámara que estaban peor representados en el vídeo de captura original.

Qué dice esto en la práctica

El simulador reproduce la estructura general de la escena con un nivel razonable de fidelidad estructural, pero no la apariencia visual al detalle. La evolución temporal del movimiento de cámara se transfiere bien. Las diferencias más importantes se concentran en segmentos concretos del recorrido, no están repartidas por igual.

Si usas estos entornos para algo que dependa de la apariencia exacta de los materiales o de correspondencias pixel a pixel, el margen de error es relevante. Si lo que te interesa es la estructura espacial y el movimiento de cámara, la cosa aguanta bastante mejor.